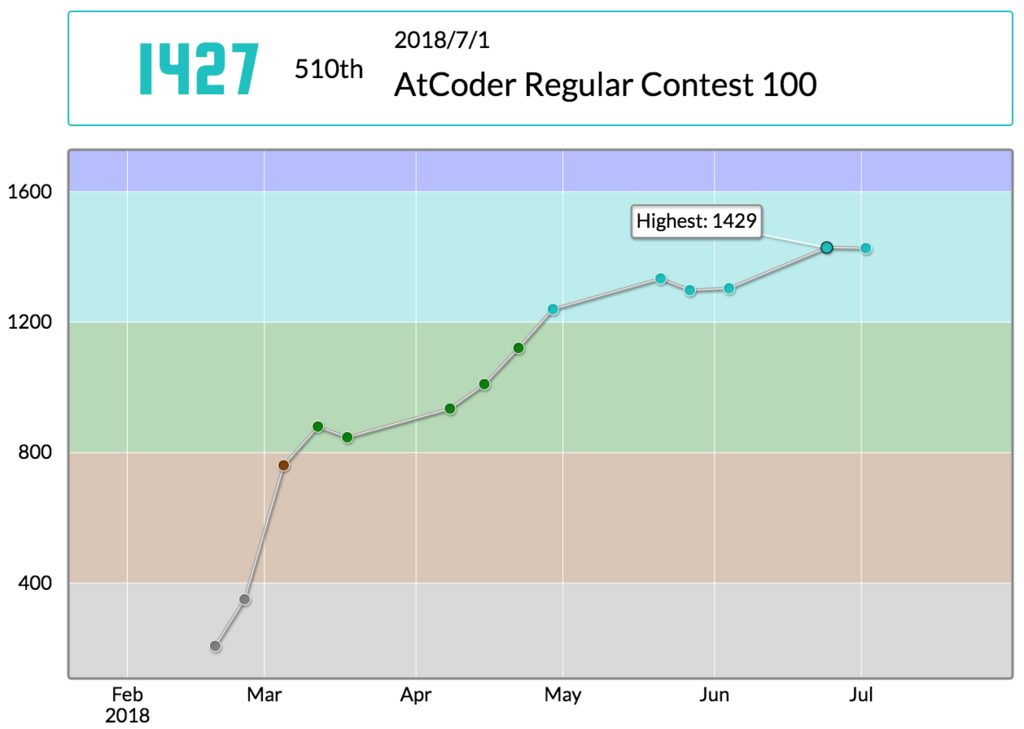

ARC100に参加した(510位)

ARC100に参加しました。結果は510位で、レートは1429→1427と微減しました。

問題としてはC問題を1WAしながらACし、D問題が解けませんでした。久しぶりにDで手こずった気がします。

今回から、解けなかった問題については典型要素の抽出をやってみたいと思います。

前回の記事:

振り返り

C - Linear Approximation

数列と整数

について

の最小値を求める問題。

予め数列からを引いておけば、あとはL1ノルムを最小化する代表値(=中央値)を

に設定すればよい。

思いつくためには、横軸、縦軸

のプロットを書いてみるとよい。横線を一本引いたときに、その横線より上に来てる点と下に来てる点が同じ数のところが最善であることに気がつくはず。

#!/usr/bin/env python N = int(input()) A = list(map(int, input().split())) A = sorted([a-(i+1) for i, a in enumerate(A)]) m = A[N//2] ans = 0 for a in A: ans += abs(a-m) print(ans)

D - Equal Cut

数列を4つに分けて、それぞれの和の最大と最小の差を最小化する問題。

端から貪欲でやるのはNG。たとえば1, 1, 1, 1, 10000とかのとき、1つの部分の合計は理想的には合計/4=2501だけど、2501になるように貪欲でとっていくと4つに分けられない。

解法は以下の通り。

- まず2つに分け終わったとする

- それぞれの部分については、理想的な分割箇所(=2つの合計ができるだけ近くなるとこ)は一意に定まる

- なので、最初の分割点を全探索して、それぞれの部分は理想的な分割にすれば、トータルの理想的な分割も定まるはず

- ちなみに、最初の分割点を右にずらすと、2段階目の分割点はそれぞれ変わらないor右にずれるのいずれかになるので、探索を減らせる

こんな感じ。これはできてもよかったな……

典型要素としては、

- 区間の累積和は予め全体の累積和を取っておけば差を利用することで

で求まる

- 「ここさえ探索すればあとは一意に定まる」みたいな感じで探索すべき場合の数を減らす

ってなところか。

#!/usr/bin/env python from itertools import accumulate N = int(input()) A = list(map(int, input().split())) Acum = list(accumulate([0] + A)) def cumsum(left, right): # [i, j) return Acum[right] - Acum[left] def find_best_cut(left, right, prev): prev = max(prev, left+1) now = prev res = now best = abs(cumsum(left, prev) - cumsum(prev, right)) while True: now += 1 score = abs(cumsum(left, now) - cumsum(now, right)) if score < best: best = score res = now else: return res left = 0 right = 0 best = float('inf') for center in range(1, N-1): left = find_best_cut(0, center, left) right = find_best_cut(center, N, right) t = [cumsum(0, left), cumsum(left, center), cumsum(center, right), cumsum(right, N)] score = max(t) - min(t) if score < best: best = score print(best)

気づいたこと

D問題まではPythonで書いて、E以降はC++で書こうと思っていたけど、E問題が解ける頻度はまだ少ないからC++で書く練習がなかなか積めないという問題点に気づいた。

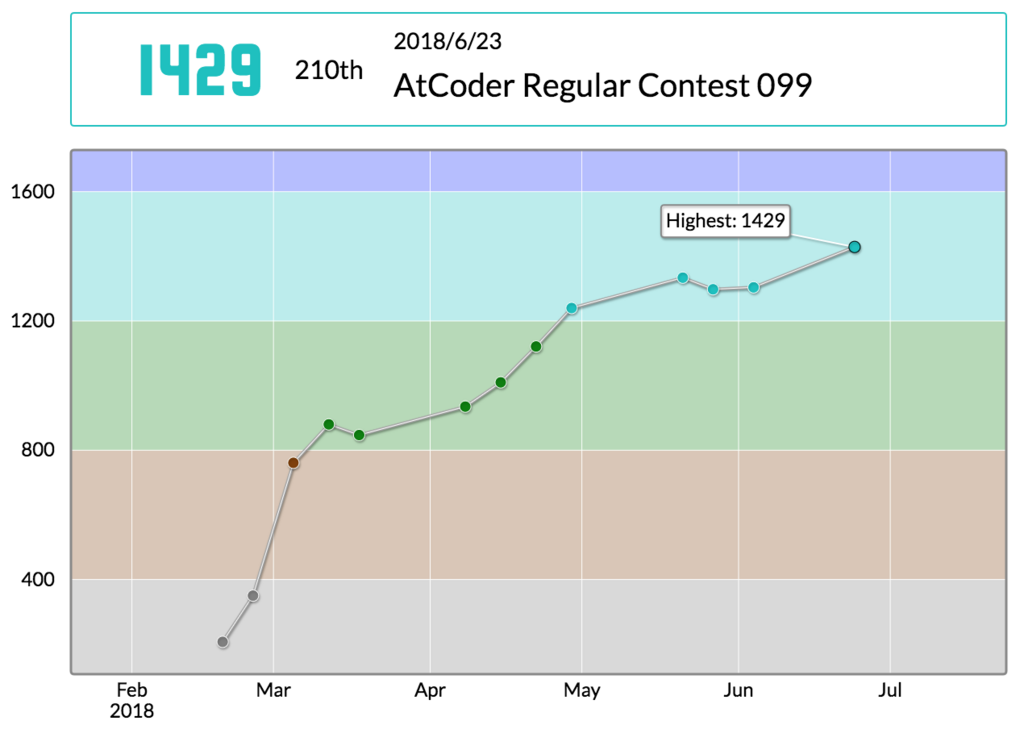

ARC099に参加した(210位)

ARC099に参加しました。210位でレートは1304→1429になりました。 久しぶりのコンテスト参加で緊張しましたが、Dをそれなりに早く解いたのがよかったっぽいです。

そういえば先日書いた記事がホッテントリに載りました。結構うれしいものですね。

振り返り

C - Minimization

- 最小値が1なので、全要素を1にすればよい

- 1回適用すると1がK-1個増える

1を中心に左右に1を広げていくイメージで解きました。1の左右それぞれについて端から最適な回数で処理をして、1の周りの余りはよしなにやる感じ。

import math n, k = map(int, input().split()) A = list(map(int ,input().split())) print(math.ceil((n-k)/(k-1)+1))

D - Snuke Numbers

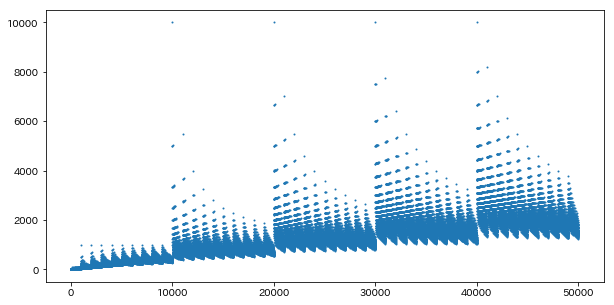

手で書いても全く分からなかったので実験しました。

import matplotlib.pyplot as plt %matplotlib inline def digit_sum(i): return sum(map(int, list(str(i)))) scores = [i/digit_sum(i) for i in range(1, 50000)] plt.figure(figsize=(10, 5)) plt.scatter(list(range(1, 50000)), scores, s=1) plt.show()

規則性があることがわかります。ちなみにスコアがジャンプするのは繰り上がりが起きるときなので、XXX999みたいな数にだけ着目すればよいと分かります。

XXX999みたいな数それぞれについて、次のやつとの比較を行って、だめだったら消せば良いと思います。

実装は鬼汚いです。

def digit_sum(i): return sum(map(int, list(str(i)))) def score(head, tail): return num(head, tail)/digit_sum(num(head, tail)) def num(head, tail): return int(str(head)+tail) k = int(input()) tail = '' head = 0 cnt = 0 last = 0 while True: head += 1 if score(head, tail) <= score(head+1, tail): if num(head, tail) > last: print(str(head)+tail) last = num(head, tail) cnt += 1 if cnt == k: break else: head = 0 tail += '9'

E - Independence

- 辺をできるだけ少なく切断して2つのクリーク(部分グラフがすべて完全なグラフ)に分割すればよい

- 補グラフを取ると少し見通しが良くなって、補グラフにできるだけたくさん辺を足して完全二部グラフにする問題に変換することができる

- 補グラフをとった時点で二部グラフでなければ達成不可能。

- 辺はいくつでも足していいので、補グラフを連結成分分解して成分の集合を2つにまとめて完全二部グラフにすることができる。

- クリークの辺の数は頂点数で決まり、辺を多くするなら頂点を多くすれば良い。ただ、頂点集合が2つあるので、2つをできるだけ同じサイズにすればよい。

- うまいまとめかたを探すためにDP

みたいな感じで解けると思います。僕は実装が間に合いませんでした。

感想

Dが早く解けたのでレートもあがり万々歳です。たのしいですね。

そろそろ証明からは逃れられなそうなので、普段から軽く証明することは意識したいと思います。

Kaggleで使えるpandasテクニック集

PythonでKaggleなどのデータ分析を行う際、pandasでゴリゴリ作業をすることが多いかと思います。

最近知って「めっちゃ便利やん!」ってなったものをまとめておきたいと思います。 全部の関数にドキュメントへのリンクを付けたので参考にしてください。

今回も検証にはTitanicのデータセットを用います。また、文中でのdf.hoge()はpandasのDataFrameのメソッドであることを、pd.hoge()はpandasの関数であることを表します。

df = read_csv('input/train.csv', index_col=0) print(df.shape) df.head()

ARC098に参加しました (726位)

ARC098に参加しました。C問題を1回TLEしてD問題が解けず無事死亡しました。 レートは1334→1298ということで、微減ですね。 D問題が解けなかったのは久しぶりなので練習不足を感じます。 最近Kaggleが忙しくて過去問埋めもあまりできていません。

前回の記事

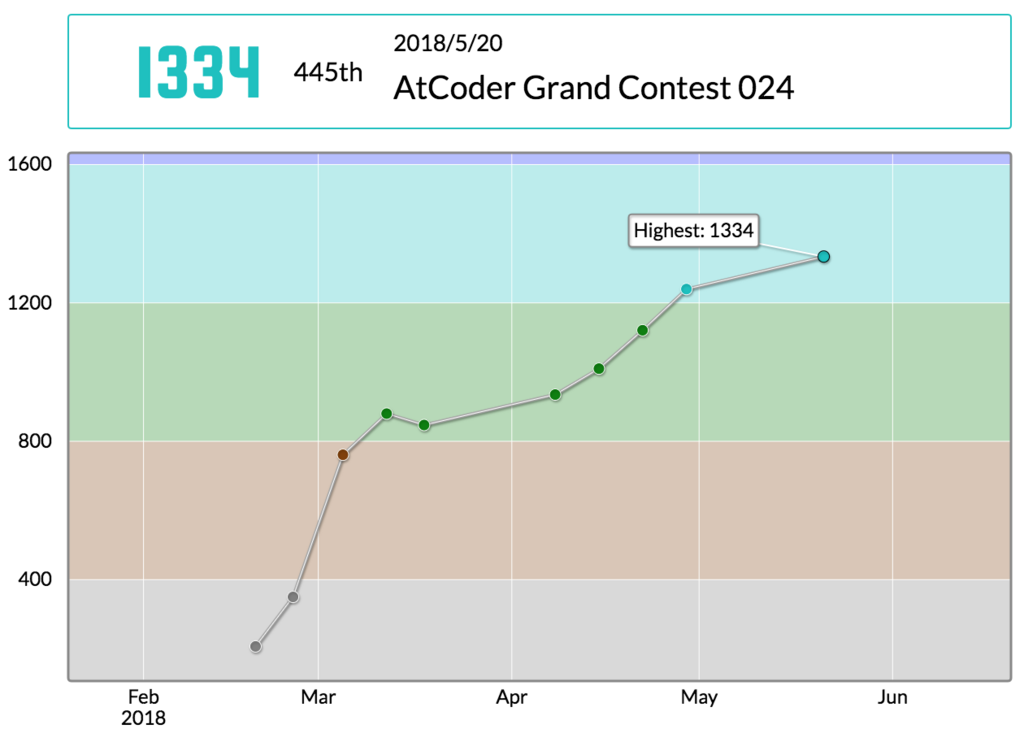

続きを読むAGC024に参加しました (445位)

ひとつの本屋で起きたこと。を読んで

バズっていたこの記事を読んでいろいろ考えたのでメモがてら残しておく。

これを読んでいる間は「なんだこの絵に描いたような無能な上司は」「たった一人のマネジメントでこんなぐちゃぐちゃになるんだなぁ」といった感想しか持たなかったが、数時間置いて読み返すと背筋が薄ら寒くなった。

これ。

繁忙期も終わっていよいよ棚の構成を考えなければならなくなっていた頃、私は『岩波文庫はなるべく少なくするように』と言われてイライラしていた。 岩波書店の本は基本的に返品できない“買切”という制度。 でも大学の書店では教授が大好きだし、授業でも使うし、他の出版社の文庫よりはるかに売れる。 そりゃぁ選書が悪けりゃ在庫が増えるけど、2ヶ月ごとに100冊は注文しているけれど、ほとんど売り切れますよと言っても『もう注文はしないで在庫だけでまわして』と言われたのでカチンとキてその日のうちに100冊近く注文した。 (悪い店員だな、真似しないように!)

それもほとんど売り切れた。でもそういう店の特徴や実績は関係ないそうだ。

多くの店舗で岩波書店の本は(大学の書店ほど)売れていないのだろうし、買切制度も相まって在庫リスクも大きい。 だから全体としては岩波文庫を縮小する方に向かったほうが「プラマイ合わせるとトータルでは」良いのかもしれない。 でも、そうじゃないよね。各店舗もプラスにすべきだよね。

データ分析をしている人は常にこういうことが起きないか気を配るべきだと思う。 油断しているとそれぞれの店で事情は違うのに「全体としての傾向としてはそうだよね」みたいな戦略を取りがちになる。

現場の感覚はきっと正しいことが多くて、一方でデータで見えてくるものもあって、 どうバランスをとって両方を活かしていくか、ということが今後求められているマネジメント層やデータアナリストの在り方ではないだろうか。

ちなみに続編もだいぶ悲惨でした。